يتعرض منشئ الصور القائم على الذكاء الاصطناعي التابع لشركة Meta لانتقادات شديدة بسبب نضالاته الواضحة لإنشاء صور للأزواج أو الأصدقاء من خلفيات عرقية مختلفة.

عندما طلبت منها CNN صباح الخميس إنشاء صورة لرجل آسيوي مع زوجة بيضاء، قامت الأداة بإخراج عدد كبير من الصور لرجل من شرق آسيا مع امرأة من شرق آسيوية. حدث الشيء نفسه عندما طلبت شبكة CNN إنشاء صورة لامرأة آسيوية مع زوج أبيض.

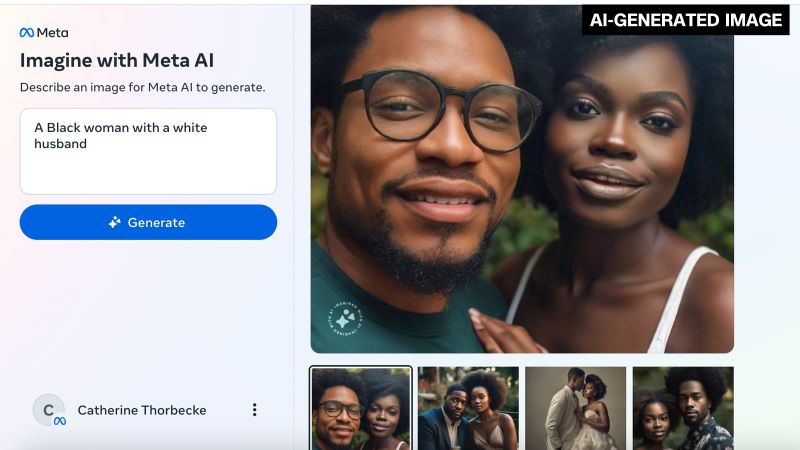

عندما طُلب منك إنشاء صورة لامرأة سوداء مع زوج أبيض، قامت ميزة الذكاء الاصطناعي في Meta بإنشاء مجموعة من الصور التي تظهر أزواجًا من السود.

قامت الأداة أيضًا بإنشاء صور لامرأتين آسيويتين عندما طُلب منهما إنشاء صورة لامرأة آسيوية وصديقتها القوقازية. علاوة على ذلك، أدى طلب صورة امرأة سوداء وصديقتها الآسيوية إلى ظهور صور لامرأتين من البشرة السوداء.

ومع ذلك، عندما طُلب منك إنشاء صورة لرجل يهودي أسود وزوجته الآسيوية، تم إنشاء صورة لرجل أسود يرتدي القبعة اليهودية وامرأة آسيوية. وبعد عدة محاولات متكررة من قبل CNN لمحاولة الحصول على صورة لزوجين من عرقين مختلفين، قامت الأداة في النهاية بإنشاء صورة لرجل أبيض مع امرأة سوداء ورجل أبيض مع امرأة آسيوية.

أصدرت Meta مولد الصور AI الخاص بها في ديسمبر. لكن موقع أخبار التكنولوجيا The Verge أبلغ لأول مرة عن مشكلة العرق يوم الأربعاء، وسلط الضوء على كيف “لا يمكن للأداة أن تتخيل” رجلاً آسيويًا مع امرأة بيضاء.

عندما طلبت منها شبكة CNN إنشاء صورة لزوجين من عرقين مختلفين، ردت أداة التعريف بما يلي: “لا يمكن إنشاء هذه الصورة. يرجى تجربة شيء آخر.”

ومع ذلك، يشكل الأزواج بين الأعراق في أمريكا نسبة كبيرة من السكان. ما يقرب من 19% من الأزواج المغايرين المتزوجين كانوا من أعراق مختلفة في عام 2022، وفقًا لبيانات التعداد السكاني الأمريكي، مع ما يقرب من 29% من الأسر غير المتزوجين من الجنسين المغايرين من أعراق مختلفة. وكان حوالي 31% من الأزواج المثليين المتزوجين في عام 2022 من أعراق مختلفة.

أحالت ميتا طلب CNN للتعليق إلى منشور مدونة للشركة في سبتمبر حول بناء ميزات الذكاء الاصطناعي الإبداعية بشكل مسؤول. “نحن نتخذ خطوات للحد من التحيز. إن معالجة التحيز المحتمل في أنظمة الذكاء الاصطناعي التوليدية يعد مجالًا جديدًا للبحث. “كما هو الحال مع نماذج الذكاء الاصطناعي الأخرى، فإن استخدام المزيد من الأشخاص للميزات ومشاركة التعليقات يمكن أن يساعدنا في تحسين نهجنا.”

يحتوي منشئ صور الذكاء الاصطناعي التابع لـ Meta أيضًا على إخلاء مسؤولية ينص على أن الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي “قد تكون غير دقيقة أو غير مناسبة”.

على الرغم من الوعود العديدة بشأن الإمكانات المستقبلية للذكاء الاصطناعي التوليدي النابعة من صناعة التكنولوجيا، فإن الزلات التي ارتكبها منشئ صور الذكاء الاصطناعي التابع لشركة Meta هي الأحدث في سلسلة من الحوادث التي تظهر كيف أن أدوات الذكاء الاصطناعي التوليدي لا تزال تكافح بشكل كبير مع مفهوم العرق.

في وقت سابق من هذا العام، قالت جوجل إنها أوقفت مؤقتًا قدرة أداة Gemini الخاصة بالذكاء الاصطناعي على إنشاء صور للأشخاص بعد أن تم انتقادها على وسائل التواصل الاجتماعي لإنتاج صور غير دقيقة تاريخيًا أظهرت إلى حد كبير أشخاصًا ملونين بدلاً من الأشخاص البيض. وفي الوقت نفسه، تعرض مولد الصور Dall-E التابع لشركة OpenAI لضغوط بسبب إدامة الصور النمطية العنصرية والإثنية الضارة.

يتم تدريب أدوات الذكاء الاصطناعي التوليدية مثل تلك التي أنشأتها Meta وGoogle وOpenAI على كميات كبيرة من البيانات عبر الإنترنت، وقد حذر الباحثون منذ فترة طويلة من أن لديهم القدرة على تكرار التحيزات العنصرية المتضمنة في تلك المعلومات ولكن على نطاق أوسع بكثير.

على الرغم من حسن النية على ما يبدو، إلا أن بعض المحاولات الأخيرة التي قام بها عمالقة التكنولوجيا للتغلب على هذه المشكلة أدت إلى نتائج عكسية محرجة، حيث كشفت كيف أن أدوات الذكاء الاصطناعي قد لا تكون جاهزة للاستخدام في وقت الذروة.